作者: Changchun Zhang , Qingjie Zhao

a Beijing Laboratory of Intelligent Information Technology, School of Computer Science, Beijing Institute of Technology, Beijing 100081, China

关键词

Partial Domain Adaptation Attention Mechanism Adversarial Networks

摘要

如何有效地从目标域的未标记样本中提取特征表示对于无监督的域自适应是至关重要的,特别是对于部分域自适应,其中源标签空间是目标标签空间的一个超空间,因为它有助于减少由于域偏移或域偏差而导致的较大性能差距。

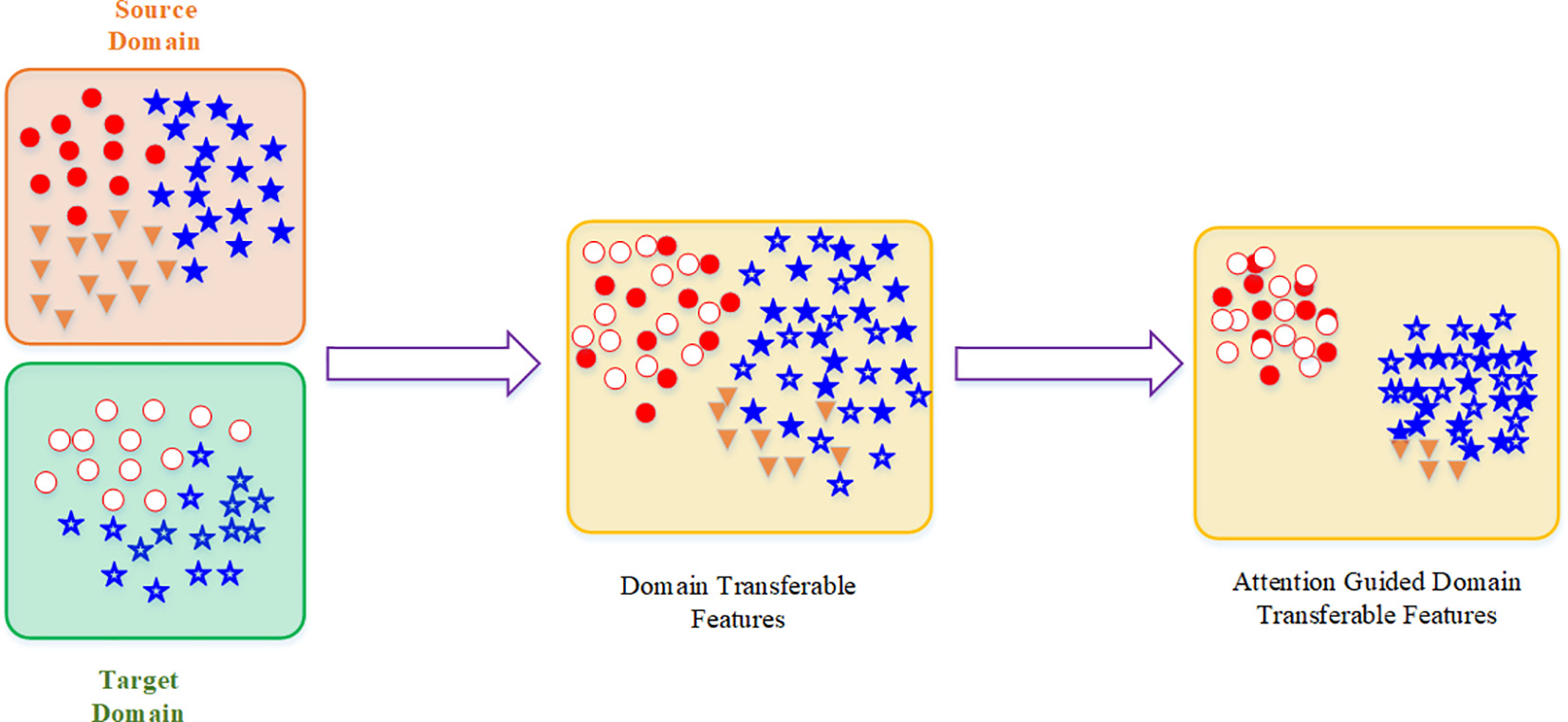

我们提出了一种基于对抗学习的局部域自适应方法和多自注意网络(MSAN)。与现有的大部分局部域自适应方法只关注高层次特征不同,MSAN主要是利用标记源数据从未标记目标数据中提取有效的高层次上下文特征和低层次结构特征。具体地说,我们提出了多重自注意网络,这是一种通过逐步增强特征来学习更细粒度和可转移特征的一般方法,这样可以相对减少域转移,从而提高模型的泛化能力。在Office-31和Office-Home数据集上的综合实验表明,该方法显著改进了表示部分域自适应方法,为各种部分转移任务提供了最新的结果。

介绍

虽然深度神经网络基于其丰富的特征表示能力,极大地提高了各种机器学习问题和应用的性能,但其训练过程在很大程度上依赖于大量的标记样本,为各种应用程序任务手动标注大量此类数据是非常必要,成本往往非常昂贵。

因此,如何有效地降低机器学习中数据标注的巨大成本仍然是一个有待解决的问题。领域自适应方法[]是一种研究得很好的策略,通过传递知识来解决这个问题,它使用一个有标记的训练数据集来改进没有标记信息的测试数据集。然而,这种有前途的领域适应范式在将类别分类器转移到目标任务方面提出了重大挑战.

虽然深度神经网络基于其丰富的特征表示能力,极大地提高了各种机器学习问题应用的性能,但其训练过程在很大程度上依赖于大量的标记样本,所以各种应用程序任务手动注释大量此类数据是非常必要的在现实生活中,成本往往非常昂贵。因此,如何有效地降低机器学习中数据标注的巨大成本仍然是一个有待解决的问题。领域自适应方法[是一种研究得很好的策略,通过传递知识来解决这个问题,它使用一个有标记的训练数据集来改进没有标记信息的测试数据集。然而,这种有前途的领域适应任务在将类别分类器转移到目标任务方面提出了重大挑战。

在统计学习中,大多数现有的域自适应方法通常假设训练和测试样本共享一致的类标签,但是遵循不同的分布,即无监督域自适应,将从源样本训练的分类器应用到目标样本。最近的研究表明,深层神经网络能够解开潜在数据集变化的解释因素,因此学习更多的域不变表示可以极大地提高域自适应的能力。沿着这条路线,这些基于特征的方法遵循的思想是将矩匹配、对抗网络和批量标准化统计嵌入深度模型,以学习领域可转移特征。

尽管这些深域自适应方法通过减少特征分布差异来桥接源域和目标域,但假设不同的两个域共享相同的标签空间。然而,在现实世界的应用中,期望源域与目标域具有相同的类别标签通常是不现实的。

因此,本文重点研究了一种更为实际的场景,即源域标签空间包含目标域标签空间,即部分域自适应(PDA)。此外,通常假设源域具有足够的多样性和规模,其标签空间包括目标域的标签空间。因此,将源域和目标域的整体匹配方法应用于部分域自适应算法并不是一种有效的方法。

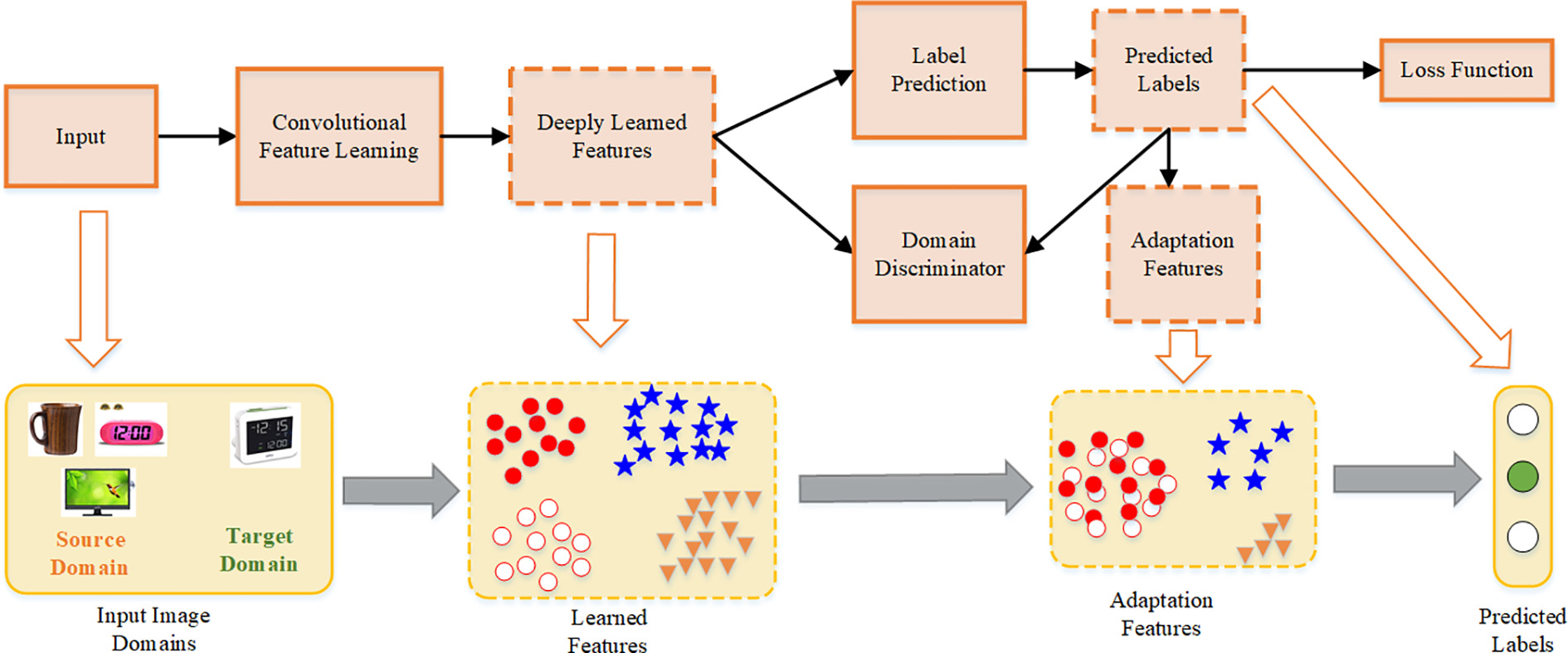

最常见的部分域自适应方法执行特征学习和标签预测,将输入图像域映射到深层特征,然后对异常源类样本降低样本权重,以减少两个不同域之间的差异,最后生成预测的标签,如图1所示。例如,Cao等人提出了部分对抗域适应(PADA)和选择性对抗网络(SAN),另一个相关工作是IWAN方法。三种方法通过在对抗性学习网络中训练的区分两个域的域识别器中对每个样本进行加权来解决部分域自适应问题。另外,最新的工作是ETN方法,它通过进一步揭示可转移量词的鉴别器结构,提高了上述三种方法的权重质量。这些局部域自适应方法只关注高层次的特征,而忽略了挖掘低层次的特征来指导深域自适应模型生成细粒度的特征表示。

- 提出了一种新的基于注意力引导的局部域自适应神经网络,以渐进的特征增强方式学习细粒度特征,提高模型的泛化能力。

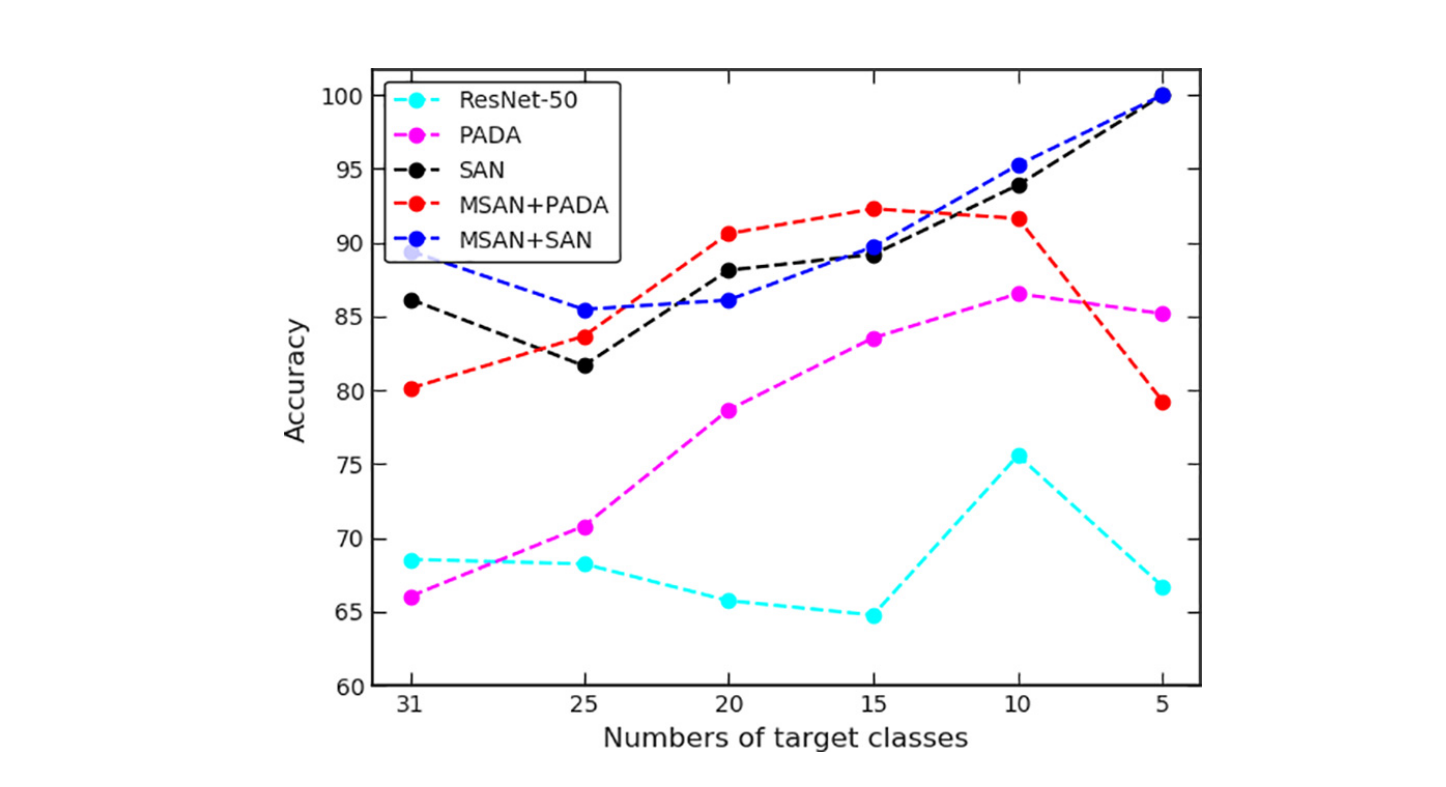

- 通过报告分类精度和注意后目标类数量变化的分类精度曲线,我们展示了我们的注意机制如何鼓励框架学习更精确的领域可转移表示。

- 通过对Office-Home和Office-31数据集的大量实验,证明所提出方法的结果超过了现有的最新结果。

研究过程

部分域适应

尽管标准域自适应技术已经取得了长足的进步,但如何有效地进行部分域自适应仍然是一个理论和实践上的未知数。因为它仍然需要一个普通的假设,即标签空间在源域和目标域中是相同的。在部分域自适应场景中,模型从一个具有丰富标签的大域转移到一个没有标签信息的小目标域,违反了这一假设。根据文献研究,目前已有四篇关于部分领域适应问题的研究进展。

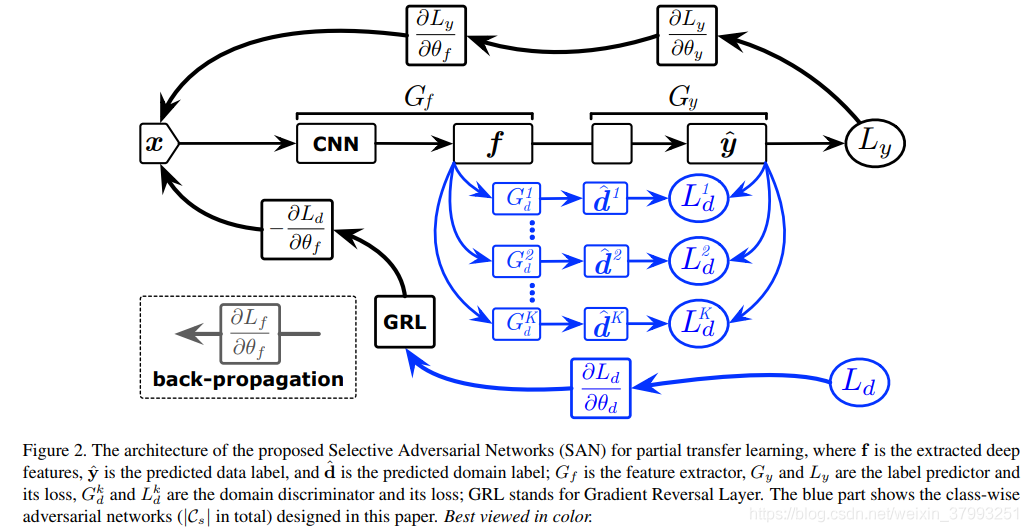

选择性对抗网络使用基于对抗学习的多个域鉴别器,引入加权机制,过滤掉属于离群点标签空间的源数据的相关部分。部分对抗域自适应是选择性对抗网络的一个改进版本,它只采用一个单域鉴别器来实现可转移特征的提取,并进一步引入类权重向量来量化每个源域类别的贡献。这些权重向量直接应用于源样本训练的分类器和源样本上的域鉴别器。重要性加权对抗网(IWAN)基于对抗学习方式,采用两个领域分类器对源实例进行加权,在离群点标签空间中选出源实例。另一个重要的工作是ETN方法,它学习如何适应相关样本,减少离群样本,用于训练标签分类器和域鉴别器。此外,它使用辅助域鉴别器和辅助标记预测来获得一个判别加权方案来量化源样本的可转移性。上述方法只利用上一卷积层的高层次特征表示,而忽略了低层次的结构特征和细粒度特征信息,这或多或少会降低模型在目标域上的性能。

自注意力

最近,自我注意机制在一系列任务中取得了显著进展。研究人员提出了SCA-CNN网络,该网络在CNN图像字幕框架中融合了空间和通道注意。据报道,多层注意网络在图像分割、图像覆盖、图像分类等方面都取得了很好的效果。尽管它在各种计算机视觉和机器学习中取得了成功,但自我注意在领域适应中从未被探索过。我们的工作将非局部自我注意机制嵌入到深度部分域自适应模型中,通过逐步增强特征的方式来学习细粒度特征以提高模型性能的可行性和有效性。

方法

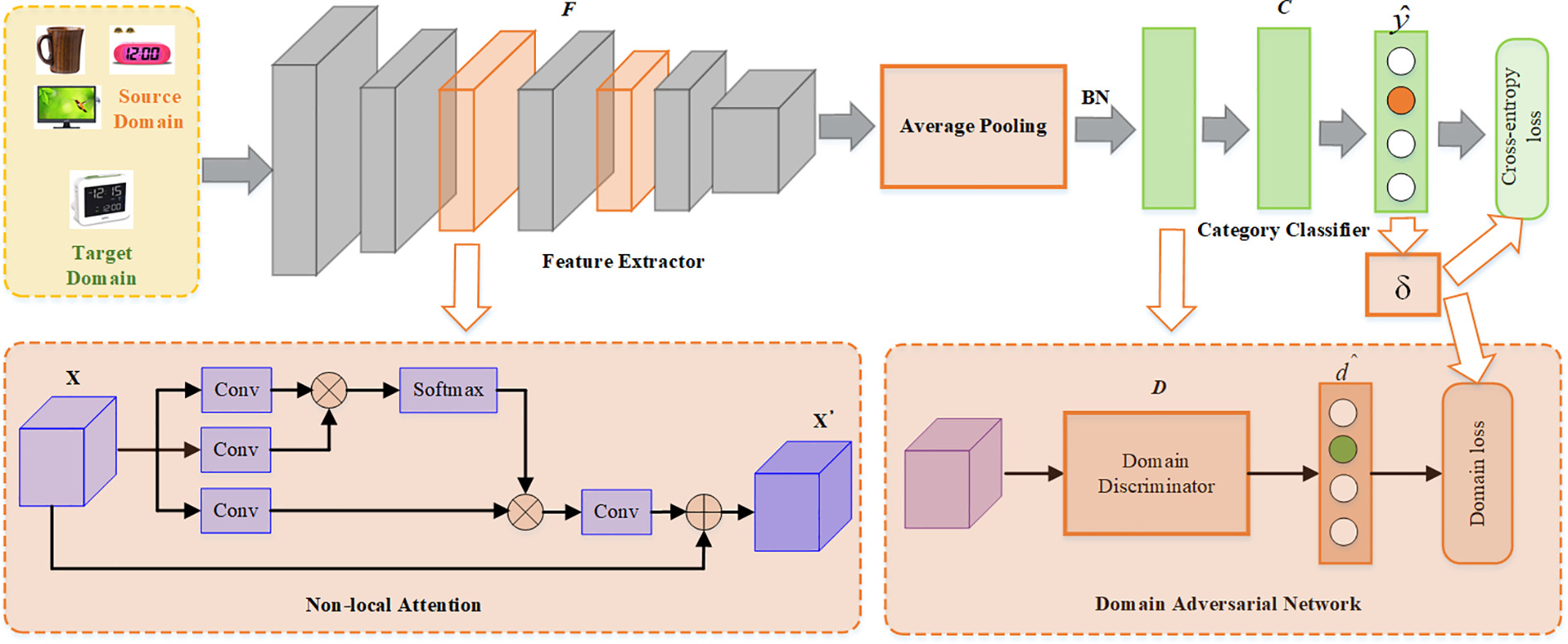

我们的方法包含一个带有多个自我注意模块的共享特征提取器F、一个域鉴别器D和一个标签分类器G。我们的网络工作框架如图3。首先,自我注意模块能够提高可转移特征表征的能力,抑制不必要的特征表征。第二,提出了一种新的网络,称为多重自注意网络(MSAN),它与基本网络一起强调从低级结构特征到高级上下文特征的意义特征。此外,底层结构特征可以引导以渐进的特征增强方式学习更细粒度的高层上下文特征。

Multiple self-attention networks

SAN

结果

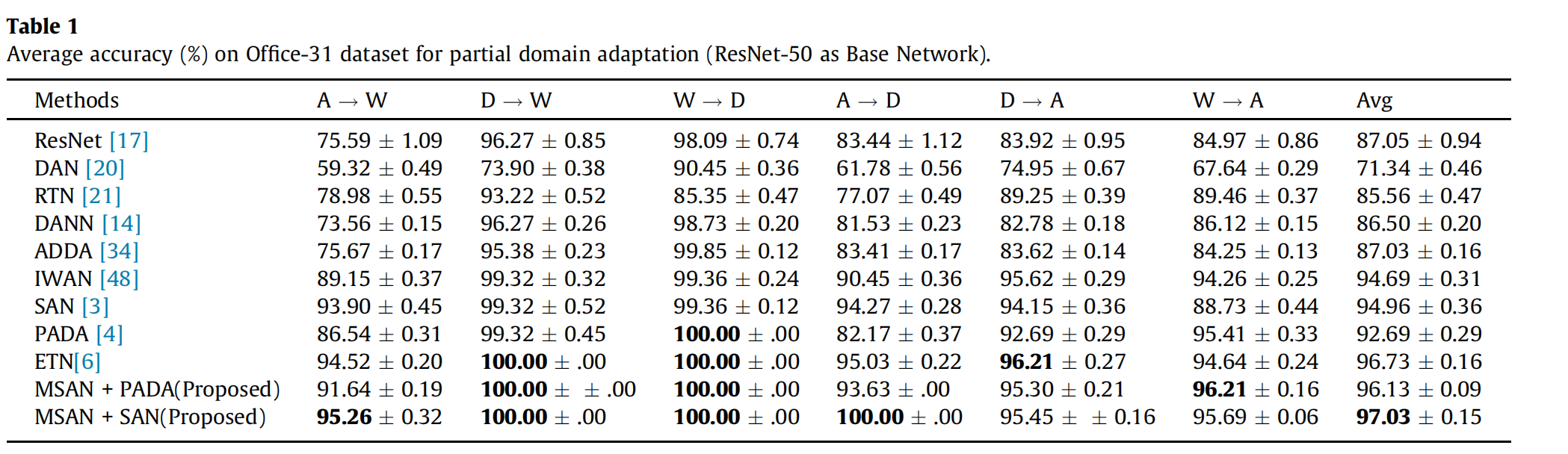

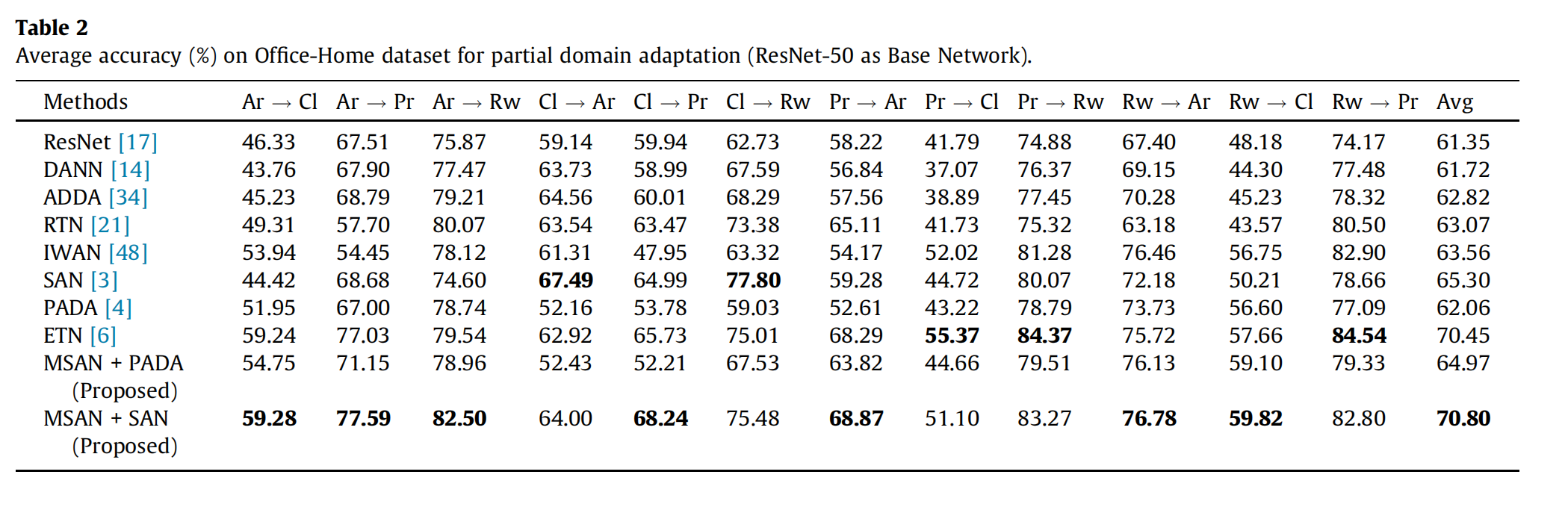

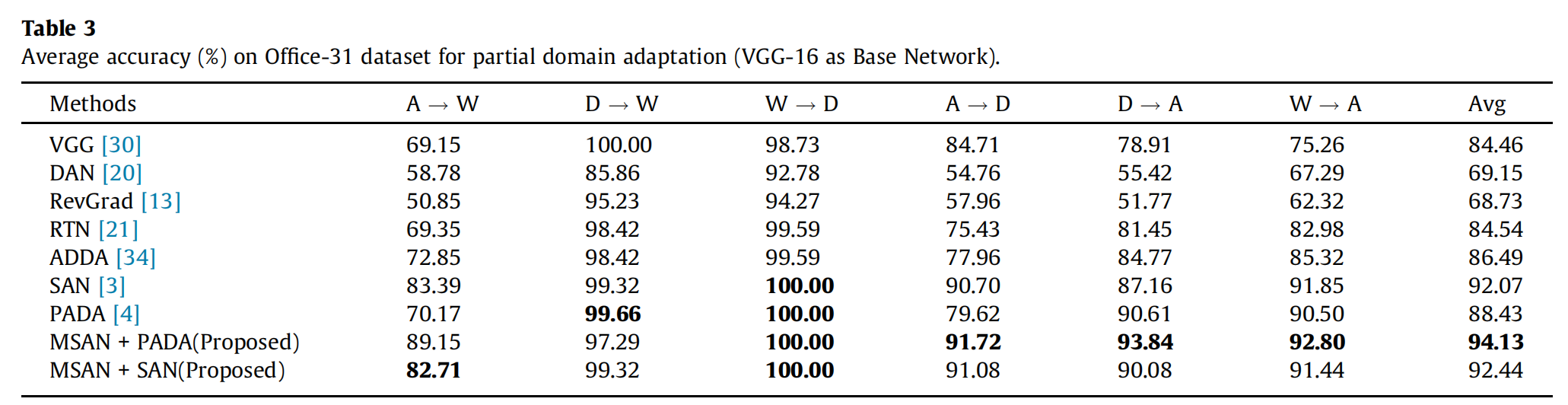

基于ResNet-50的Office-31和Office-Home数据集的部分域适配结果如表1和表2所示。我们还比较了Office-31数据集和VGG-16数据集上的不同方法,结果如表3所示。

我们的模型在平均准确率方面优于所有其他方法,表明我们的方法在不同数据集上适用于不同的基网络。具体来说,结果揭示了几个观察结果。

(1) 我们的方法显著提高了域对抗网络的性能,并取得了最新的成果。

(2) 我们的方法还提高了PADA和SAN的(平均)分类精度。由于SAN是一种更先进的方法,导致提升空间相对较小,因此我们对PADA的推广更为明显。这证明了MSAN在训练过程中有效地学习更多领域可转移特征表示的有效性。

(3) 如表1、表2和表3所示,多重自我注意网络成功地减少了两个不同领域的领域偏差。这意味着多个自注意网络能够有效地从底层结构特征和高层上下文特征中提取特征,并与基本网络一起实现部分域自适应任务。

(4)通过基于VGG-16主干的训练,多个自我关注网络提高了Office-31数据集上PADA和SAN的性能。这表明,多个自注意网络也有利于基于不同基础网络的局部域适应任务,是一种通用的方法,可以很容易地插入到任何域适应网络。

讨论

在这项工作中,我们研究了如何学习更多的可转移的特征表示,这些特征表示来自高级上下文特征和低级结构特征,用于部分域自适应。以往的研究主要集中在高层次的上下文特征上,我们发现低层次的结构特征可以引导学高层次上下文特征。因此,引入的自我注意部分域自适应方法学习更多的域可转移特征表示,从而减轻由于离群源类引起的负迁移。在Office-31和Office-Home数据集上的综合实验表明,我们的模型能够产生显著的性能增益。